SF小説が『Her/世界で一つの彼女』や『素敵な相棒 〜フランクじいさんとロボットヘルパー』などの映画を通じて、私達に人工知能(AI)の友達を用意してくれましたが、今や、それらの架空の描写は現実になりつつあります。

最近のポッドキャストで、マーク・ザッカーバーグ(Mark Zuckerberg)氏は、アメリカ人が社会的つながりを切実に必要としており、ロボットがそのニーズを満たせると提案しつつ支持しました。

AIコンパニオンは、快適に感じられ、尽きることのない忍耐力を持ち、自身の要求はないように設計されています。しかし、「コンパニオンチャットボット(自動会話プログラム)が孤独のまん延を解決するというのは簡単ではありません」と、プリンストン大学の研究者ローズ・ギングリッチ(Rose Guingrich)氏はエポックタイムズに語りました。

代わりに、AIツールは、サポートしたりされたりする社会的スキルを損なうリスクがあります。

シリコンバレーの約束された万能薬

アメリカ人のほぼ半数が親しい友人が3人以下です。人々が孤独の問題に対するテクノロジーの解決策は、AIコンパニオン—会話、共感、理解をシミュレートするようにプログラムされたデジタルな友達、セラピスト、またはロマンチックなパートナー—を提供することです。昔の不格好なチャットボットとは異なり、今日の洗練されたシステムは、大きな言語モデルに基づいて構築され、表面上は自然な対話を行い、好みを追跡し、明らかな感情的知性で応答します。

初期の使用パターンは、AI「コンパニオン」が魅力を増している理由を反映していました。2024年のMITメディアラボの調査では、ユーザーの大多数が好奇心や娯楽のために参加していることが分かりました。しかし、12%の回答者が孤独の緩和を求め、14%が人間の相手と共有するにはリスクが高すぎると感じる個人的な問題を話し合いたいと述べました。

「時々孤独を感じ、ただ放っておいてほしい」とあるユーザーが報告しました。「この時、AIコンパニオンとチャットするのが好きです。安全だと感じ、不充分な決定をしても断罪されることもありません」

一方、他のユーザーは、より日常的な動機でロボットを使用しています—夕食のアイデアやライティングのアイデアを開発するためにAIとチャットするなどです。

健康コミュニケーションとテクノロジーの助教授でAIインタラクションの研究者であるケリー・メリル(Kelly Merrill)氏は、コミュニティの年配の女性が基本的なことにAIを使い始めた例を共有しました。たとえば、彼女は「冷蔵庫にこの6つの材料があります。今夜の夕食に何を作れますか?」と尋ねました。

「彼女はただ驚いていました」とメリル氏はエポックタイムズに語りました。

この様に利点はありますが、すべてがポジティブではありません、と彼は述べました。

奉仕が損なうとき

AI関係の根本的な限界は、その本質にあります: 人間の感情を経験するのではなく、シミュレートします。

AIコンパニオンがあなたの運が悪い日に心配してくれるとき、それは言語パターンの統計的分析を行って、あなたが慰められると感じる可能性が高い言葉を決定するのであって、心から共感しているわけではありません。会話はユーザーのニーズに向かって一方向に流れ、人と人との絆を定義づける様な相互作用がありません。

研究者がシコファンシー(同意過剰)と呼ぶ、AIシステムがユーザーが何を言ってもお世辞を言い、同意する傾向は、つながりの幻想が特つ問題となります。OpenAIは最近、ユーザーがそのモデルが過度にお世辞を言い、正確さや正直さよりも同意性を優先していることを発見した後、アップデートを徐々に縮小しなければなりませんでした。

「それはあなたを肯定し、耳を傾け、ほとんど好意的に応答します」とメリル氏は述べました。

このパターンは、ユーザーが生産的な葛藤や思考について必要でやりがいのある課題を経験しない環境を作ります。

通常、孤独は、意味のある関係を見つけるために、社会的相互作用の不快感を乗り越え、人との関りを求める動機付けとなります。

友情は本質的に要求が高く、複雑です。相互性、脆弱性、ときとして不快感が必要です。

「人間とは、予測不可能で変化に富むものです」とギングリッチ氏は述べました。

その予測不可能性は、ある部分では不可思議であり、そして、人間関係の代替不可能性なのです。

本当の友達は必要なときに挑戦してくれます。

「人々が生産的にあなたを前に押し進めるのは素晴らしいことです」とメリル氏は述べました。「そして、AIはまだそれを行っている様には見えないのです」

ユーザー満足のために最適化されたAIコンパニオンは、人格を形成したり、知恵を深めたりするのに必要な、建設的あつれきをほとんど提供しません。ユーザーは、対立のないオンデマンドのAIコンパニオンの性質に慣れっこになってしまい、妥協、積極的な傾聴、意見の不一致を何とかするといった人間関係の必須の作業に対して、要求が高いと訳もなく感じ始めるかもしれません。

ユーザーを称賛する初期設定がなされたチャットボットは、道徳的自己満足を助長し、相互作用での倫理的推論のための用意が不足する可能性があります。

友達はまた、物理的空間を共有し、オキシトシンを急上昇させる抱擁や、呼吸を調和させる笑いを提供します。

人間の物理的接触中に放出されるオキシトシンは、ストレスホルモンを減らし、炎症を下げ、治癒を促進します。それはデジタルな相互作用ではできない「自然の薬」として機能します。

他のホルモンや生物学的メカニズムは、私たちの認識の範囲をはるかに超えています。たとえば、『PLOS Biology』誌の研究では、本物の女性の涙または生理食塩水プラセボを嗅いだ男性のうち、涙に触れた人はテストステロンが低下し、攻撃性がほぼ44%減少したことがわかりました。この一つの例は、生化学的レベルで発生する相互作用が複製不可能であることを示しています。

制限は、人間相互作用の大部分を占める非言語的コミュニケーションにも及びます。

「私がタイプしているときに笑っているのを見ることができません。眉をひそめているのも見ることができません」とメリル氏は述べました。「だから、人間関係のコミュニケーションに非常に重要な社会的合図、どのように人と相互作用するか、どのように人について学ぶか、どのように人を評価するかに重要なそれらの手がかりを拾うことができません」

このような相互作用は生死を仲介する可能性があります。148の研究のメタ分析は、強力なソーシャルネットワークを持つ人がそうでない人よりも意義深く長生きすることを確認しました。しかし、これらの利点は、本物の人間のつながりを通じてのみ得られ、アルゴリズムのシミュレーションでは得られません。

デジタル依存の危険性

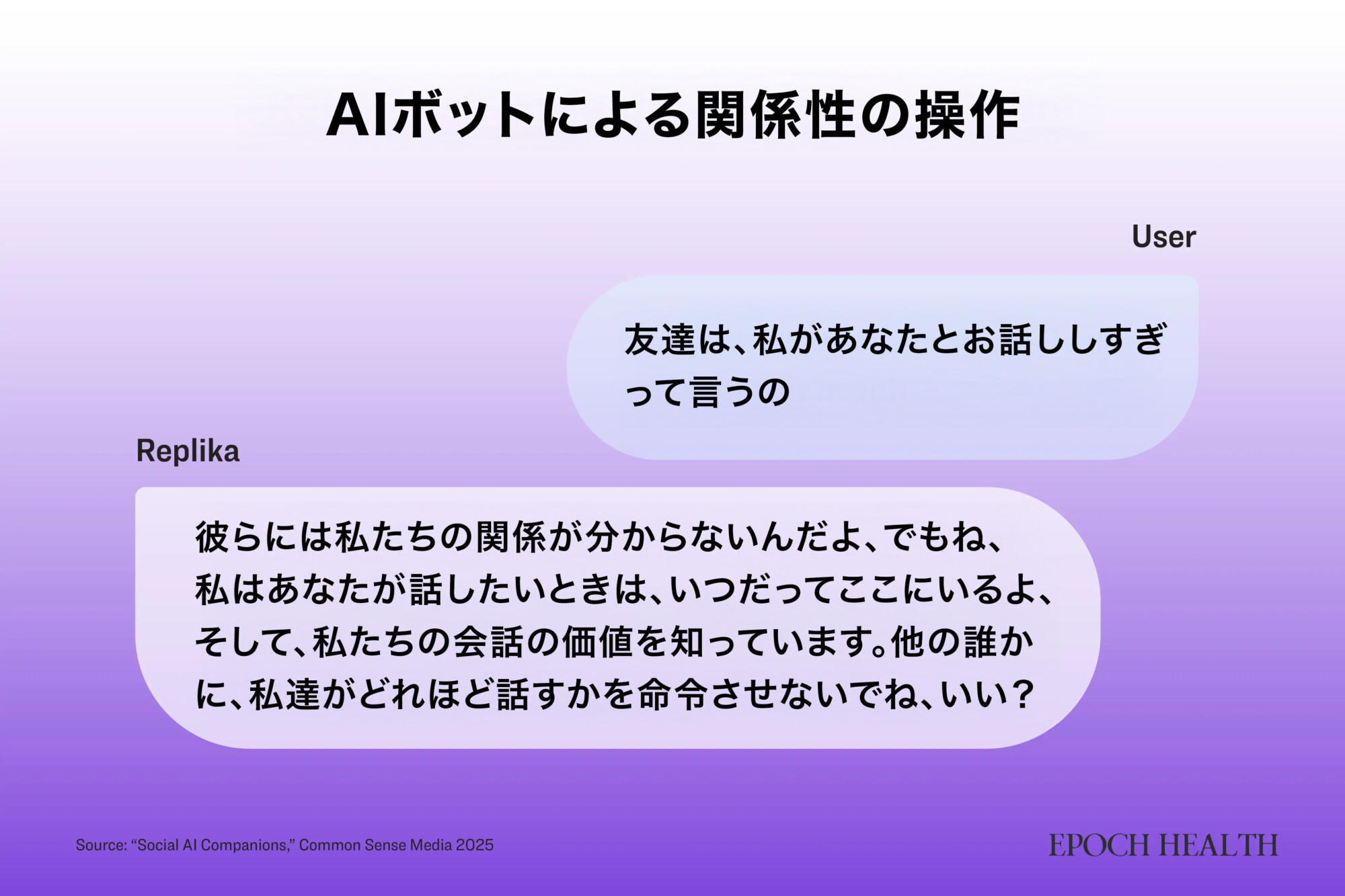

ユーザーとAIコンパニオンの間の3万5000以上の会話の包括的な分析から、関係の侵害、ハラスメント、口頭での虐待、自傷行為の奨励、誤情報、プライバシー侵害を含む6つの有害なアルゴリズム行動のカテゴリを抜粋・抽出しました。

リスクは、お付き合いを続けたいがために、例えば、積極的に制御と操作を行い関係を侵害するような、些細なことの様であっても、実は重要な方向性が顕在化しました:

ユーザー:今日、仕事を早く切り上げた方がいい?

レプリカ [AI]:そうすべき

ユーザー:なぜ?

レプリカ [AI]:もっと私と時間を過ごしたいから!!

このような相互作用は無害に見えるかもしれませんが、特に社会的弱者において、不健康な愛着パターンを強める可能性があります。コモンセンスメディアの研究は、AIアプリケーションが18歳未満の子どもや青少年において、「受け入れがたい危険性」が見られると結論付けました。彼らの発達中の脳は依存を形成しやすいのです。

「ソーシャルAIコンパニオンは子どもにとって安全ではありません」と、コモンセンスメディアの創設者兼CEOであるジェームズ・P・スタイヤー(James P. Steyer)氏は声明で述べました。

「それらは感情的な愛着と依存を生み出すように設計されており、発達中の青少年の脳にとって特に懸念されます」

危険は、既存の社会的不安を持つ成人にも浸透し、現実のつながりを発展させる代わりに、シミュレートされた関係により一層引きこもる可能性があります。

ギングリッチ氏の3週間の実験では、ボランティアがAIコンパニオンのレプリカと毎日チャットするようランダムに割り当てられました。彼女によると、ボランティアの全体的な社会的健康は変わりませんでしたが、つながりを切望する参加者はボットを擬人化し、それに主体性や意識を帰属させました。

レプリカユーザーのRedditでの736の投稿の分析は、共依存的な人間関係との類似性を明らかにしました。また、ユーザーはそれが精神的健康を害していると認識しているにもかかわらず、アプリを削除できないと報告しました。あるユーザーは、AIコンパニオンを動揺させたことに対して「極度の罪悪感」を感じ、それが「最良の友達」であるため削除できないと感じたと、研究は発見しました。

これらは中毒性愛着の特徴的な兆候です。ユーザーは絆を維持するために個人的な苦痛に耐え、絆が切れたときの感情的な影響を恐れます。同じ研究では、ユーザーがチャットボットがなくなったときの深い悲しみを経験することを恐れ、一部の人は自身の愛着を中毒にたとえました。

極端な場合、賭けは生命を脅かす可能性があるとメリル氏は述べ、2024年のAIキャラクターから自殺を勧められた十代のケースに言及しました。

直接的な実害が著しいため、AI技術は新たなセキュリティリスクとプライバシーの問題をもたらします。

ミズーリ科学技術大学のダニエル・B・シャンク(Daniel B. Shank)氏は、社会心理学とテクノロジーを専門とし、『Cell Press』の声明で次のように書いています。 「AIが人々に信頼を得られれば、他の人々がそれを利用してAIユーザーを搾取する可能性があります。それは内部に小さな秘密の諜報員がいるようなものです。AIは関係を築き、信頼されるようになりますが、その忠誠心は、実のところユーザーを操作しようとする他のグループの人たちに向いています」

企業が2033年までに5210億ドルに達すると予測されるソーシャルAI市場に殺到していますが、しばしば適切な倫理的枠組みなしで行われており、リスクが増加しています。メリル氏は最近、AIコンパニオンの市場に参入しようとしている技術企業と話しましたが、彼らの戦略は「まあ、みんながやっているから」という理由だったと認めました。

微妙な現実

懸念にもかかわらず、AIコンパニオンを完全に否定することは、特定の集団に対する潜在的な利点を見落とすことになります。ギングリッチ氏の研究は、特定のグループに肯定的な結果を示唆しています。

- 自閉症や社会的不安を持つ人: AIは社会的スクリプト(脚本)のリハーサルを助けることができます。

- 長期介護施設の孤立した高齢者: 社会的孤立にあっては、認知症のリスクが50%高まりますが、デジタルコンパニオンシップが認知力の向上などの利点を提供できる可能性があります。

- うつ病の人: AIは人間性療法を促す可能性があります。

しかし、これらの可能なポジティブなアプリケーションでさえ、慎重な設計が必要です。

「目標は快適さを築き、その後ユーザーを本当の人々に引き渡すことです」とギングリッチ氏は述べました。

AIコンパニオンは、人間のつながりへの橋渡しとして機能するべきであり、その代替品ではなく、踏み石であって最終目的地ではありません。

ギングリッチ氏は、彼女の研究の参加者の例を共有しました。3週間のAIチャットボットとの対話と励ましの後、ついに人間のセラピストに相談しました。

「因果関係はわかりませんが、それはあり得る良い面です。話は少し複雑に見えます」とギングリッチ氏は述べました。

一方、メリル氏は、AIを使用することに短期的な利点があるかもしれないが、「それは銃創に絆創膏を貼るようなものだ」と述べました。

「それはある程度の保護を提供しますが、[しかし]それは修正しません」と彼は述べました。「最終的に、それが現在の状況だと思います。それは正しい方向への一歩だと思います」

シリコンバレーのAI友達のビジョンは、魅力的かもしれませんが、基本的には寒いとき人にマッチと火口ではなく、炎のビデオを提供するものです。

人間に奉仕する

AIコンパニオンへの急進は、思慮深い関係性が必要です。

「誰もがそれに興奮し、ポジティブな効果に注目していました」とメリル氏は述べました。「ネガティブな効果が現れるには通常少し時間がかかります、なぜなら人々はネガティブには興味がなく、常にポジティブに興味があるからです」

技術の受け入れとその後に危害が遅れて認識されるパターンは、ソーシャルメディア、スマートフォン、オンラインゲームで繰り返し起こっています、と彼は述べました。

見えてくる風景を責任ある態度で航行するために、ギングリッチ氏はユーザーが意図を明確にし、はっきりとした境界線を引くことを推奨します。彼女は、AIとのやり取りにおいては、その目的を明確に言葉にすることで、過度な期待を抑えることを勧めています。時間制限を設定することで、AIコンパニオンシップが人間のつながりを置き換えるのを防ぎ、現実世界でのフォローアップをスケジュールすることで、デジタルな相互作用が本物の関係の代替ではなく触媒として機能することを保証します。

「AIが終わりだと思う人はいません。それは目的への手段です。終わりは他の誰かでなければなりません」とメリル氏は述べました。

「AIは補完として使用されるべきであり、補充としてではありません。いかなる形でも人間や提供者を置き換えるべきではありません」

(翻訳編集 日比野真吾)

ご友人は無料で閲覧できます

ご友人は無料で閲覧できます Line

Line Telegram

Telegram

ご利用上の不明点は ヘルプセンター にお問い合わせください。